ভারতের গাজিয়াবাদে তিন বোনের মর্মান্তিক মৃত্যু সংবাদ হিসেবে নিঃসন্দেহে হৃদয়বিদারক। প্রাথমিকভাবে পাওয়া ভারতীয় গণমাধ্যমের তথ্য অনুযায়ী ১৬ বছরের বিশিকা, ১৪ বছরের প্রাচী এবং ১২ বছরের পাখি- তিন কিশোরীই একটি কোরিয়ান অনলাইন টাস্ক-ভিত্তিক গেমে ভয়াবহভাবে আসক্ত ছিল। পরিবার ও স্কুল থেকে বিচ্ছিন্ন হয়ে পড়া এই মেয়েগুলোর জীবনযাপন ধীরে ধীরে ভার্চুয়াল জগতে আটকে গিয়েছিল। যার শেষ পরিণতি হলো এমন ভয়াবহ ঘটনার বাস্তবায়নের মধ্য দিয়ে।

ওই তিন কিশোরীর বাবার ভাষায়, “ওরা বলত কোরিয়া আমাদের জীবন, কোরিয়াই আমাদের ভালোবাসা।” দুই বছর ধরে স্কুলে না যাওয়া, পরিবার কর্তৃক মোবাইল ব্যবহারে নিয়ন্ত্রণ আরোপের চেষ্টা- এসব নানা ঘটনার প্রেক্ষিতে মানসিক ভেঙে পড়া সব মিলিয়ে ঘটনাটি কেবল একটি দুর্ঘটনাই নয়, বরং ডিজিটাল আসক্তির ভয়াবহ দিকের একটি সতর্ক সংকেতও বটে।

কিন্তু এই ট্র্যাজেডির সঙ্গে আমাদের দেশের প্রেক্ষাপটে যুক্ত আরেকটি দিক রয়েছে, যেটি ভুক্তভোগী বা তাদের পরিবারের কোনো দায় নয়। এটি আমাদের দায়, যারা এই বিষয়গুলোতে সংবাদ প্রচার করে ঘটনাগুলো দেশের গণ্ডি ছাপিয়ে বহির্বিশ্বেও তুলে ধরছে- সেই সংবাদমাধ্যমের দায় এটি। তবে একজন সাধারণ পাঠক হিসেবে তা প্রায়শই বেশিরভাগের চোখ এড়িয়ে যাওয়ায় আলোচনার বাইরে থেকে যাচ্ছে। মূল কথা হলো, এই ধরনের সংবাদ পরিবেশনের ক্ষেত্রে আমাদের গণমাধ্যমের দায়িত্বহীনতা।

বিষয়টি বোঝার জন্য চলুন একটু বিস্তারিত আলোচনা করা যাক।

উপরে উল্লেখ করা তিন বোনের আত্মাহুতির ঘটনাটি ভারতীয় গণমাধ্যমের পাশাপাশি বাংলাদেশি সংবাদমাধ্যমেও ব্যাপকভাবে প্রচারিত হয়েছে। টেলিভিশন, অনলাইন নিউজপোর্টাল, সামাজিক যোগাযোগমাধ্যম- সবখানেই খবরটি ছড়িয়েছে দ্রুতগতিতে। কিন্তু লক্ষ্য করার মতো বিষয় হলো, নামিদামি একাধিক দেশীয় গণমাধ্যম নিহত তিন বোনের ছবি হিসেবে যে ছবিগুলো ব্যবহার করেছে, সেগুলো বাস্তব কোনো আলোকচিত্র নয়, বরং তা এআই (কৃত্রিম বুদ্ধিমত্তা) জেনারেটেড ইমেজ। আরও উদ্বেগজনক হলো, তাদের দেওয়া এই ছবির ওপর ভিত্তি করে অসংখ্য বাইট-সাইজ ডিজিটাল মিডিয়া ও ফেসবুক পেজ সেই একই ছবিগুলো পুনঃব্যবহার করেছে, কোনো যাচাই বা ব্যাখ্যা ছাড়াই।

অথচ ছবিগুলো একটু মনোযোগ দিয়ে দেখলেই বোঝা যায়- চোখের অস্বাভাবিক গঠন, ত্বকের কৃত্রিম মসৃণতা, আলো-ছায়ার অসামঞ্জস্য- সবই এআই ইমেজের পরিচিত লক্ষণ। প্রশ্ন হলো, তাহলে এই ভুলটা বারবার হচ্ছে কেন?

কোনো নিউজে প্রাসঙ্গিকতা আনার জন্য এআই, কৃত্রিম বুদ্ধিমত্তা দিয়ে তৈরি ছবি ব্যবহার করা কোনো অপরাধ নয়। কিন্তু সমস্যাটা হলো, যখন আপনি এই ধরনের কোনো কিছু ব্যবহার করার পূর্বে উল্লেখ না করেই তা ব্যবহার করেন, তখন আপনার সাংবাদিকতা ও বিশ্বস্ততার প্রশ্নে একটি প্রশ্নবোধক চিহ্ন থেকে যায়।

বাংলাদেশের একাধিক বিশ্বাসযোগ্য ফ্যাক্টচেকিং প্ল্যাটফর্ম বহুবার দেখিয়েছে, কীভাবে যাচাইহীন ছবি ও ভুয়া ভিজ্যুয়াল আমাদের গণমাধ্যমে জায়গা পাচ্ছে। রিউমার স্ক্যানার (Rumor Scanner) তাদের একাধিক প্রতিবেদনে তুলে ধরেছে, দেশি-বিদেশি বিভিন্ন ঘটনার খবরে বাংলাদেশি মিডিয়া প্রায়শই স্টক ফটো, পুরনো ছবি কিংবা সাম্প্রতিক সময়ে কৃত্রিম বুদ্ধিমত্তা দিয়ে তৈরি ছবি ব্যবহার করছে।

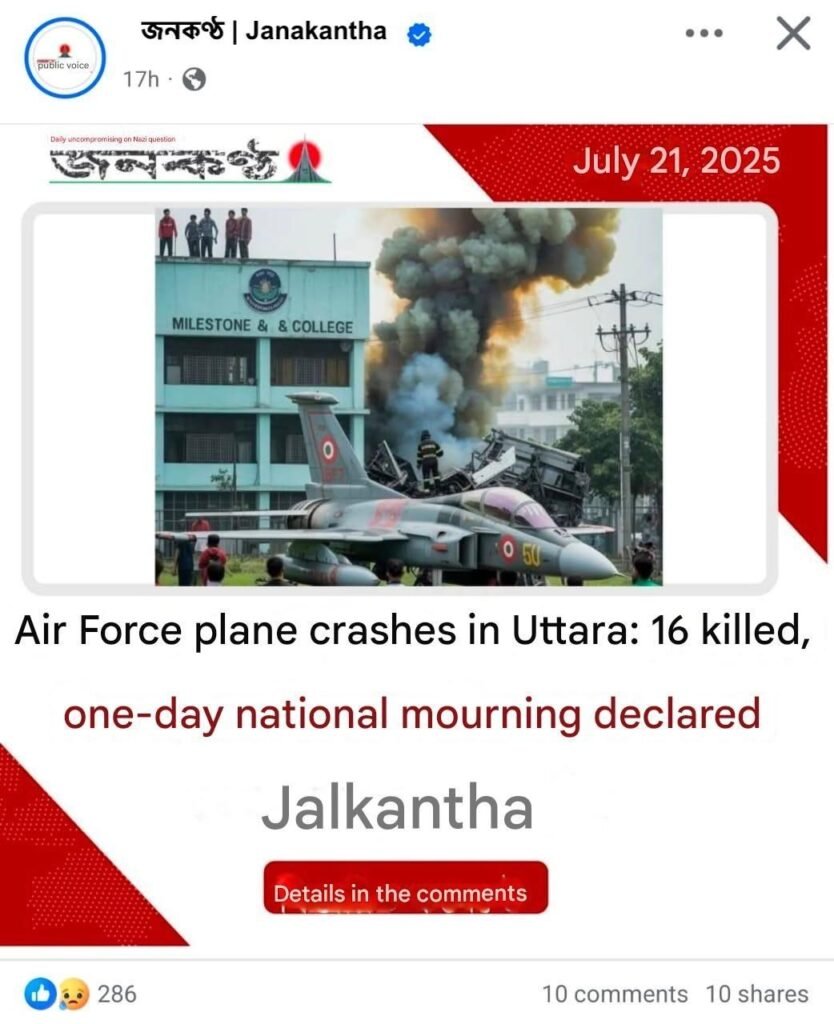

এখানে উদাহরণ হিসেবে গত বছরের জুলাইয়ে রাজধানীর উত্তরার দিয়াবাড়িতে মাইলস্টোন স্কুল অ্যান্ড কলেজের ওপর বিধ্বস্ত হওয়া বিমানবাহিনীর এফ-৭ বিজিআই বিমানের কথা উল্লেখ করা যায়। সেখানে দ্রুত ও তৎক্ষণাৎ নিউজ প্রচারের জন্য দেশের নামিদামি বেশ কিছু গণমাধ্যম এআই দিয়ে তৈরি ছবি ব্যবহার করেছিল। যা নিয়ে পরে রিউমার স্ক্যানার তাদের প্রতিবেদন প্রকাশ করে ঘটনার প্রকৃত বাস্তবতা তুলে ধরে।

এছাড়া বুম বাংলাদেশ (Boom Bangladesh) বিভিন্ন সময়ে প্রকাশিত ফ্যাক্টচেকে দেখিয়েছে, কীভাবে এআই জেনারেটেড যুদ্ধক্ষেত্র, বন্যা বা শিশুর কান্নার ছবি সত্য ঘটনা হিসেবে প্রচারিত হয়েছে। ফ্যাক্টওয়াচও একই ধরনের বিভ্রান্তিকর ভিজ্যুয়াল কনটেন্ট নিয়ে বারবার সতর্ক করেছে। তবে বারংবার সতর্ক করা হলেও এই প্রবণতা কমছে না, বরং লক্ষ্য করা যাচ্ছে দিনে দিনে তা বেড়েই চলেছে। যার সাম্প্রতিক উদাহরণ দেওয়া হয়েছে এই লেখার শুরুতেই।

খোঁজ নিয়ে দেখা গেছে, এই সমস্যার মূল জায়গা হলো গণমাধ্যমে “দ্রুত/আগে/প্রথম” হওয়ার অসুস্থ এক প্রতিযোগিতা। ছবি না থাকলে খবর অসম্পূর্ণ মনে হবে- প্রথমেই একটি ছবি সম্বলিত খবর দিতে পারলে সামাজিক যোগাযোগমাধ্যমে লাইক, কমেন্ট, শেয়ার বেশি পাবে- এই ধারণা থেকে অনেক সম্পাদকীয় ডেস্ক যাচাইয়ের ধাপ এড়িয়ে যাচ্ছে। কিন্তু তারা এটি ভুলে যাচ্ছে যে সংবাদ শুধু তথ্য নয়, এটি একটি বিশ্বাসের সম্পর্ক। একটি সংবেদনশীল ঘটনায় ভুয়া বা কৃত্রিম ছবি ব্যবহার মানে কেবল ভুল করা নয়, বরং পাঠকের সঙ্গেও একপ্রকার প্রতারণা করা।

কৃত্রিম বুদ্ধিমত্তা দিয়ে তৈরি ছবি ব্যবহার করাটা অপরাধ বিষয়টা এমন নয়। বিভিন্ন আন্তর্জাতিক গণমাধ্যমেও এখন এআই ভিজ্যুয়াল ব্যবহৃত হচ্ছে। তবে সেখানে একটি মৌলিক নীতি মানা হয়। এআই দিয়ে তৈরি করা যেকোনো কিছুর পাশেই দেওয়া থাকে স্পষ্ট ব্যাখ্যা, যাতে যেকোনো পাঠক সেই সংবাদটি পাঠ করার সময় বিভ্রান্ত না হন যে এটাই আসল ছবি বা ভিডিও। তবে আমাদের দেশীয় বিভিন্ন মিডিয়ায় সেই ন্যূনতম সততাটুকুও অনেক সময় দেখা যায় না। সবার আগে নিউজ দেওয়ার প্রতিযোগিতায় তারা সাংবাদিকতার সাধারণ নিয়মকানুনকে প্রায়শই হেয় জ্ঞান করছেন।

ফলে কী হয়? সাধারণ পাঠক ধরে নেয়, এটাই ঘটনার আসল ছবি। শোক, সহানুভূতি, ক্ষোভ- সব আবেগ গড়ে ওঠে একটি কৃত্রিম মুখের ওপর। দীর্ঘমেয়াদে এটি শুধু বিভ্রান্তি নয়, বরং গণমাধ্যমের বিশ্বাসযোগ্যতাকে ধীরে ধীরে ক্ষয় করছে।

যেকোনো ঘটনা নিয়ে সংবাদ প্রকাশের আগে চাইলেই সোর্স খোঁজা যায়, একটু সময় ব্যয় করলেই সত্য-মিথ্যা যাচাই করা সম্ভব। দরকার শুধু সদিচ্ছা ও পেশাগত দায়বদ্ধতা। সংবাদমাধ্যম যদি সেই দায় নিতে ব্যর্থ হয়, তাহলে ফ্যাক্টচেকাররা যতই চেষ্টা করুক, ক্ষতিটা হয়ে যায় আগেই।